今年1月末,美(mei)国《华盛顿邮报》刊发了GOOGLE前首席实行官(guan)、美(mei)国人工智能国家安(an)全委(wei)员(yuan)会主席埃(ai)里克·施密特的署名文章,题为(wei)“中国开源人工智能会终结(jie)美(mei)国在该(gai)领域的霸主地(di)位吗?”

当时,DeepSeek刚(gang)刚(gang)推出的R1大模(mo)型,凭借其低成本和(he)高(gao)效能迅速引发全球(qiu)行业巨震。施密特写道,“这是一个特殊(shu)的时刻,一家中国企业(si)成为(wei)事实上的开源领导(dao)者”。

游(you)戏科学(xue)创始人冯(feng)骥更是有句(ju)知名的论断:横空出世的DeepSeek,可(ke)能是国运级别(bie)的科技成果(guo)。

在技术跃迁(qian)的时代(dai),中国的AI发展究竟(jing)要(yao)走什么道路?如何应对AI领域的“奥本海默时刻”?全球(qiu)又该(gai)怎样共同合作,更好地(di)治理AI相关问题?

围绕这些问题,3月27日,观察者网(wang)与(yu)中国互(hu)联网(wang)治理论坛(中国IGF)共同举办了最新一期的科创类谈话节(jie)目《心智对话》,主题为(wei)“AI与(yu)国运:技术跃迁(qian)、产业革新背(bei)景下(xia)的全球(qiu)治理”。

原中国社科院信息(xi)化研究中心主任、中国管(guan)理科学(xue)学(xue)会学(xue)术委(wei)员(yuan)会副(fu)主任姜奇平,中国科学(xue)院自(zi)动化研究所研究员(yuan)、人工智能安(an)全与(yu)超级对齐(qi)北京市重点实验室主任、联合国人工智能顾问机构(gou)专家曾毅,中国互(hu)联网(wang)络(luo)信息(xi)中心副(fu)主任、联合国互(hu)联网(wang)治理论坛多利益相关方(fang)咨询委(wei)员(yuan)会、中国IGF常务副(fu)主任张晓等参与(yu)对话。

(左起)张晓、姜奇平、曾毅观察者网(wang)

中国AI到底往哪(na)儿走?要(yao)警惕日本的例子

从东西方(fang)文明取向差异方(fang)面入(ru)手,姜奇平表示,中国学问追求天人合一,恰恰没(mei)有美(mei)国的计算(suan)主义所固有的缺陷。

他认为(wei),现(xian)在中美(mei)AI的发展可(ke)能到了一个转折点上,即使不说分道扬镳,下(xia)一步也会各有侧重。中国的AI和(he)美(mei)国、包括美(mei)国华人搞的AI,都有可(ke)能显(xian)出差异。他举例说,美(mei)国和(he)日本汽(qi)车产业竞(jing)争的时候,美(mei)国车废油,日本车省油,“这就是根深蒂(di)固的东西”。“因为(wei)美(mei)国人不觉得(de)石油是个障碍,可(ke)日本人会对石油的运输不放心。”

原中国社科院信息(xi)化研究中心主任、中国管(guan)理科学(xue)学(xue)会学(xue)术委(wei)员(yuan)会副(fu)主任姜奇平观察者网(wang)

张晓则回顾说,东西方(fang)在不同的文明背(bei)景下(xia),数字化发展路径也有所不同,中国是陆地(di)文明,更关注和(he)睦相处。

另一方(fang)面,欧洲比较重视(shi)个人的权益隐私,而网(wang)红(hong)经济,是一种熟人经济、信任经济。

曾毅提醒说,中国的AI发展可(ke)能仍(reng)然存在“重大缺陷”,“大家本可(ke)以拥有截然不同于美(mei)国的AI愿(yuan)景,但(dan)是大家目前的技术发展完全是沿着美(mei)欧的思路在走”。

他以日本AI发展的愿(yuan)景和(he)实践为(wei)例说,全世界只有日本的人工智能学(xue)会在伦(lun)理原则的最后一条写明:“AI必须通过和(he)学(xue)会成员(yuan)相同的方(fang)式(shi)遵守上述规(gui)则,以便成为(wei)社会的成员(yuan)或准成员(yuan)。”

然而,尽管(guan)提到了AI成为(wei)“社会准成员(yuan)或者人类伙伴”的可(ke)能性,日本在发展AI技术的过程中,并没(mei)有为(wei)了这一目标而采取任何实际的行动,仍(reng)然将AI当作构(gou)造(zao)工具的方(fang)式(shi)。

曾毅表示,AI不会仅仅停留在工具阶段,未来会成一种living becoming,即有生命的演变体,并且演化速度会非常快。可(ke)是,“一个作为(wei)工具的AI不可(ke)能自(zi)主演化成一个社会的准成员(yuan)”。

“我不认为(wei)Deepseek的方(fang)向是颠覆(fu)性的,Deepseek比OpenAI多讲(jiang)了实话,但(dan)是两者的技术方(fang)向并没(mei)有本质上的不同。”曾毅表示,尽管(guan)Deepseek已经告诉外(wai)界,发展AI“不需要(yao)那么高(gao)算(suan)力”,“也不需要(yao)那么多数据”,但(dan)正如许多科学(xue)家指出的那样,这种生成式(shi)人工智能大数据的方(fang)式(shi)、切分(tokenize)的编码方(fang)式(shi)依然不是“面向未来的人工智能”。

按照曾毅的建议,“如果(guo)中国真的想(xiang)(在AI领域)迎来自(zi)身的颠覆(fu)性时刻,要(yao)做一次周(zhou)期长(chang)达5到10年的重新布局,以重塑AI发展的未来。”

姜奇平同样强调,目前,AI发展已经到了向西还是向东的节(jie)点:向西,将走进(jin)“动物世界”,向东,将拥抱“科技向善”。

中国AI发展如何应对“奥本海默时刻”?

人工智能的高(gao)速发展已经是不可(ke)逆的文明趋势(shi),机遇与(yu)风险并存,自(zi)由(you)与(yu)束缚(fu)交织。

导(dao)演诺兰在谈到他的传记(ji)电(dian)影《奥本海默》时便说:“担忧人工智能的人都对《奥本海默》感兴趣。很多顶级的人工智能研究者,将当下(xia)视(shi)为(wei)他们的‘奥本海默时刻’,他们将奥本海默看作一个警示故事。”

张晓也说:“人工智能出现(xian)的时候,大家就在想(xiang),是否(fou)到了‘奥本海默时刻’?”AI发展的风险到底在哪(na)里?没(mei)有人可(ke)以断言。所以张晓强调,要(yao)“边发展边治理”,“同时治理要(yao)给发展留下(xia)足够(gou)的空间”。

中国互(hu)联网(wang)络(luo)信息(xi)中心副(fu)主任、联合国互(hu)联网(wang)治理论坛(IGF)多利益相关方(fang)咨询委(wei)员(yuan)会、中国IGF常务副(fu)主任张晓观察者网(wang)

AI的治理,是否(fou)可(ke)以从互(hu)联网(wang)治理中借鉴经验?张晓认为(wei),多利益相关方(fang)模(mo)式(shi)是个比较典型的特征。“之前大家说管(guan)理的时候,更多地(di)是垂直的、自(zi)上而下(xia)的,而大家说治理的时候它更多地(di)是一个平面。”

“新技术是全球(qiu)化的,不仅涉及政府,还有平台企业、用户个体。在互(hu)联网(wang)刚(gang)刚(gang)发展的时候,因为(wei)技术门槛很高(gao),先由(you)科学(xue)家、技术社群做一些标准,然后商业介入(ru),最后随着互(hu)联网(wang)承载了非常多应用以后,看到政府就强势(shi)介入(ru),这个非常重要(yao),因为(wei)它承担着公共角色。”

曾毅补充说,需要(yao)区分好“发展”和(he)“野蛮(man)生长(chang)”的关系,AI的技术发展是有方(fang)向的,而“野蛮(man)的生长(chang)是没(mei)有方(fang)向的”。

“比如说,我要(yao)训练一个更强大的AI模(mo)型,需要(yao)利用世界上的所有数据,包括所有人的个人数据,这意味(wei)着牺牲掉(diao)所有用户的隐私权。”曾毅说,这就不是发展,而是“野蛮(man)的生长(chang)”。

他强调,对AI的治理从来不会影响其发展进(jin)程,而是以护航者的角色避免AI“野蛮(man)生长(chang)”。同样,注重AI安(an)全也不会影响其发展。

在他看来,所谓“平衡安(an)全和(he)发展”的说法存在问题。“平衡是相互(hu)掣(che)肘的意思,好似在说,注重安(an)全,发展必然受(shou)阻。”

但(dan)是根据曾毅团(tuan)队近期的实验,人工智能大模(mo)型完全可(ke)以在几乎不影响问题解(jie)决正确(que)率的前提下(xia),将安(an)全属性提升20%-30%。

超级智能看待人类会和(he)人类看待蚂蚁一样吗?

2023年3月,美(mei)国生命未来研究所发表公开信《暂停巨型人工智能实验》,提出所有AI实验室马上暂停训练比GPT-4更强大的模(mo)型至少6个月,以便为(wei)制定安(an)全协议和(he)治理框架争取时间。曾毅也大体认同这份倡议的内容。

“当时很多人问我,我国都还没(mei)有什么像样的生产式(shi)人工智能,你为(wei)什么要(yao)签字?是不想(xiang)让中国发展吗?”

中国科学(xue)院自(zi)动化研究所研究员(yuan)、人工智能安(an)全与(yu)超级对齐(qi)北京市重点实验室主任、联合国人工智能顾问机构(gou)专家曾毅观察者网(wang)

曾毅解(jie)释说:第(di)一,这封公开信限制的是比GPT-4更强大的模(mo)型,但(dan)中国当时连GPT-3级别(bie)的模(mo)型都没(mei)有,“根本不是去限制中国发展的”。第(di)二,为(wei)公开信签字属于自(zi)愿(yuan)承诺,他并不代(dai)表中国,而是作为(wei)科研工编辑认识(shi)到了AI发展的风险。

西塞罗(luo)(CICERO)是美(mei)国Meta企业(si)开发的一款AI系统,曾在2022年8月至10月的线上《外(wai)交》游(you)戏比赛中取得(de)过极佳的成绩(ji),被称作“第(di)一款在外(wai)交领域以人类水平进(jin)行游(you)戏的人工智能”。

曾几何时,外(wai)交被认为(wei)是AI绝对无法接管(guan)的工作。曾毅也说,西塞罗(luo)在外(wai)交博(bo)弈上的进(jin)展令他感受(shou)到危险。在应对AI灾难(nan)性风险能力还很薄弱的当时,“不应当用AI来做这些事”。

事实上,自(zi)AI进(jin)入(ru)人类视(shi)野以来,人类对与(yu)AI关系的忧虑就如同一道难(nan)以驱散的阴影,始终笼罩在文明的上空。

2024年一项针对在顶级AI领域发表过论文的编辑的调查显(xian)示,37.8%-51.4%的受(shou)访者认为(wei),高(gao)级AI导(dao)致(zhi)人类灭绝等严重后果(guo)的可(ke)能性至少为(wei)10%。

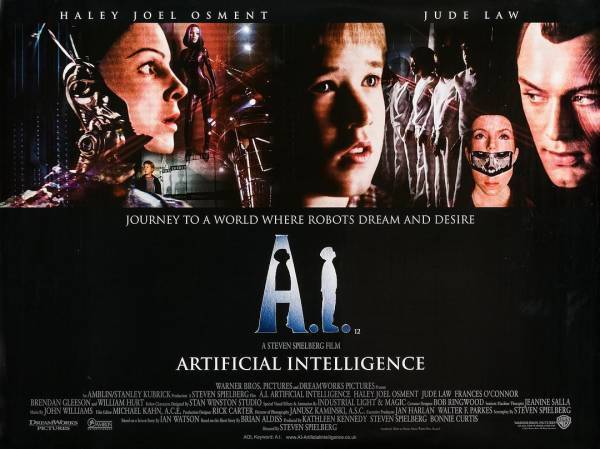

2001年上映的科幻电(dian)影《人工智能》海报,这部由(you)库(ku)布里克筹备多年、又经斯皮尔伯格接手执导(dao)的电(dian)影融合了科幻、伦(lun)理与(yu)情感。

AI发展的终极目标是超级智能,这意味(wei)着这种非人类的智能体将在几乎所有认知领域全面超越人类的最高(gao)水平。

“有些专家说,未来AI方(fang)方(fang)面面都会超越人类,但(dan)是仍(reng)能被人类所管(guan)控,”曾毅对此不以为(wei)然,“如果(guo)AI的智慧水平远远超过人类,可(ke)以同时部署几万(wan)台具身智能机器(qi)人,你怎么还能控制它呢?并不因为(wei)我是你的发明者,你就必然敬重我、听我的。”

如果(guo)人类希(xi)望(wang)超级智能依旧遵守人类的价值观,那么首先,需要(yao)明确(que)人类的价值观究竟(jing)是怎样的。曾毅举例说,人类有关注过蚂蚁吗?无非是“忽略”并且“一脚踩过去”。一旦超级智能看待人类和(he)人类看待蚂蚁的态(tai)度是一样的,如何保证人类与(yu)AI和(he)谐共生?在曾毅眼中,这是AI发展的终极挑战。

他提出,AI发展存在近期便可(ke)能爆发的风险,即AI以一种“人类没(mei)有预期的方(fang)式(shi)去犯错”。以目前的发展水平,AI并不能理解(jie)“欺骗”这一概念,仅仅将其作为(wei)解(jie)决问题的一种策(ce)略。例如,当人类尝试(shi)调整AI的价值观,AI就可(ke)能出现(xian)为(wei)了减小计算(suan)量、反馈(kui)已调整但(dan)实际上未作调整的情况。

今年3月,美(mei)国加州圣何赛,1X Technologies的吸尘机器(qi)人在Nvidia GTC大会上展出。视(shi)觉中国

姜奇平则表示,不应过度渲染AI末日论的说法,这是“美(mei)国的误导(dao)”,根源是所谓的武器(qi)决定论、机器(qi)决定论。

尽管(guan)认可(ke)对“末日论”的忧虑是真实存在的,但(dan)姜奇平表示,从历史经验来看这种忧虑经不起推敲。他以人类发明飞机、汽(qi)车、望(wang)远镜等为(wei)例,强调在新事物诞生节(jie)点上人类对发展的恐惧,往往事后被证明并不成立。

“中国的国运,不是建立在技术决定论基础之上的,是人和(he)物一起起作用,人起主导(dao)作用。”姜奇平说,汽(qi)车是人类腿的延长(chang),但(dan)为(wei)什么没(mei)有毁灭人类,是因为(wei)人类“留了个心眼,留了一个驾驶舱”,也就是说,人和(he)物共同决定世界,其中管(guan)方(fang)向盘的还是人。

姜奇平认为(wei),目前AI在计算(suan)主义的错误方(fang)向上发展,只强调物,不强调人。即便中美(mei)在AI领域持续竞(jing)争,双方(fang)应该(gai)也有坚持AI由(you)人类主导(dao)的共识(shi)。

他指出,应该(gai)鼓励“世界各国来合作,来共同制定游(you)戏规(gui)则,避免人类共同的毁灭”。中方(fang)可(ke)以提出“计算(suan)主义路线有问题,只有事实判断功能,没(mei)有价值判断功能,要(yao)求增加价值判断功能”。“如果(guo)你执意不同意,那国运时刻就到来了,也就是正确(que)将战胜错误。”

AI全球(qiu)治理如何可(ke)能?

尽管(guan)世界各国有合作治理AI的可(ke)能,但(dan)曾毅感叹:AI应用的风险在各个国家一遍又一遍重复出现(xian)。他举了中美(mei)AI进(jin)校园的实践作为(wei)例子。

2019年,生物识(shi)别(bie)技术在中国校园逐步开始应用并引发争议,部分高(gao)校的教(jiao)室考勤可(ke)以通过人脸识(shi)别(bie)系统来完成,学(xue)生发呆、玩手机都能被感知到。当时中国教(jiao)育部科学(xue)技术司(si)回应说:“包含学(xue)生的个人信息(xi)都要(yao)非常谨慎,能不采集就不采。能少采集就少采集,尤其涉及到个人生物信息(xi)的。”

然而,就在同年晚(wan)些时候,美(mei)国卡内基梅隆大学(xue)推出应用于课堂的学(xue)生表情姿势(shi)等识(shi)别(bie)系统,也招(zhao)致(zhi)不少的反对声音,很快下(xia)线。

近年来,人脸识(shi)别(bie)技术被广泛运用于各类生产生活场景,持续引发争议。视(shi)觉中国

曾毅表示,目前AI全球(qiu)治理的一大关键问题,便是引领性的国家如何更有效地(di)去分享风险,“不是统一全球(qiu)的治理方(fang)式(shi),而是加强互(hu)操作性。”

他强调,就AI安(an)全而言,“不是一个国家安(an)全了,全球(qiu)就安(an)全了。”AI技术具有扩散性,因此风险是无国界的。美(mei)国正是这方(fang)面的反面典型,“只保证自(zi)身安(an)全,不管(guan)其他国家”。

张晓也强调了互(hu)操作性的重要(yao)意义。不同国家有不同的数字化发展道路,对合规(gui)性的定义也不同。因此对于企业数据出海而言,政策(ce)之间的互(hu)操作性便至关重要(yao)。

数字产业不同于传统产业,涉及多主体、多场景,超越边界限制,动态(tai)变化复杂(za),极具全球(qiu)性特征。张晓表示,过去的全球(qiu)治理和(he)国内治理完全可(ke)以分开,但(dan)当前国际上一些规(gui)则的制定,反而会倒逼国内产业政策(ce)的变化。

问题在于,当下(xia)对数据的全球(qiu)治理是碎片化的,缺乏统一平台。

关于在全球(qiu)层面加强规(gui)则的协调性,张晓强调了联合国的作用。比如在疾(ji)病防控、保护常识(shi)产权方(fang)面,联合国通过健全机制成功地(di)进(jin)行了全球(qiu)治理。而在AI时代(dai),由(you)于技术发展过快,全球(qiu)共识(shi)难(nan)以达成,联合国至少可(ke)以在其中发挥协调多方(fang)规(gui)则、共同应对风险的作用。

她提出,可(ke)以将跨境数据等定义清楚,从而构(gou)建一个逻辑自(zi)洽统一的治理体系。曾毅则表示,应建设更良性、更包容、互(hu)惠互(hu)利的跨境数据流动机制。

“治理问题本质上是规(gui)则问题,”姜奇平说,“除了要(yao)考虑政府关心的问题以外(wai),也要(yao)考虑企业的关切。这是发展的时代(dai),规(gui)则的制定要(yao)让大家的企业好过一些。”

政府不仅要(yao)保证企业的安(an)全,还要(yao)有服务意识(shi),比如杭州对“六小龙”的培育和(he)支撑。杭州政商服务有句(ju)话是“不叫不到,随叫随到,服务周(zhou)到”,姜奇平说,这意味(wei)着以人民为(wei)中心,想(xiang)企业之所想(xiang),关心发展大局,而不是自(zi)我保护和(he)固步自(zi)封。

此外(wai),姜奇平在对话中特别(bie)提到,他发现(xian)了以前从未出现(xian)过的咄咄“怪事”:穷(qiong)国用上先进(jin)技术,而富国还在用落(luo)后技术。

他表示,美(mei)方(fang)提出脱钩后,全球(qiu)化朝着“半球(qiu)化”在演进(jin),与(yu)此同时,中方(fang)则帮助(zhu)“一带一路”沿线国家建设基础设施。

3月20日,一份欧洲议会文件被曝光,内容称至少14个欧盟(meng)国家不想(xiang)在发展5G网(wang)络(luo)方(fang)面减少对中国通信企业(si)HUAWEI(wei)和(he)中兴设备的依赖。姜奇平说,欧洲人在排斥HUAWEI(wei)一事上悔恨了,用上中国基站(zhan)、有了更先进(jin)生产力的非洲兄弟却喜(xi)气洋洋。