界面资讯记者 | 张倩楠(nan)

界面资讯编辑 | 刘海(hai)川

界面资讯记者 | 张倩楠(nan)

界面资讯编辑 | 刘海(hai)川

今年以来,中国多家(jia)医院正加速推进DeepSeek大模型本地化部署,掀起AI驱动诊疗变(bian)革新风暴。

据不完全统计,截至(zhi)目前,国内已有超百家(jia)三级医院官宣完成DeepSeek本地化部署,涉及北京、上海(hai)、广东、江苏、浙江等(deng)20余个省份,包(bao)括北京大学第一医院、清华(hua)长庚医院、上海(hai)第六人民医院、郑州(zhou)大学第一附属医院、深圳(chou)大学附属华(hua)南医院、北京中医药(yao)大学深圳(chou)医院、湖南省人民医院等(deng)。

作为一项(xiang)基于(yu)深度学习(xi)和大数据分析的智能技术,DeepSeek可用于(yu)临床、科(ke)研、医院运营管理等(deng)数十种医疗场景。

其中冲击感最强的莫过于(yu)在临床上的使用。首都医科(ke)大学三博脑科(ke)医院神经外科(ke)主(zhu)任张宏伟就(jiu)公开分享了他(ta)的“震惊”。他(ta)在门(men)诊遇到(dao)一位超复杂脑瘤患者,患者已经过两次开颅手术、一次经鼻手术、一次放疗、一次伽马刀治(zhi)疗,肿瘤仍未被控制。张宏伟把患者情况发给DeepSeek,仅(jin)18秒后,它(ta)就(jiu)给出了一份明(ming)确的方案,张宏伟能想到(dao)的、文献上报道的都有,而且包(bao)括最新的临床实验(yan)。“对于(yu)脑肿瘤这类(lei)比较(jiao)复杂的问(wen)题,DeepSeek的水平至(zhi)少相(xiang)当于(yu)省级三甲(jia)医院专家(jia)。” 张宏伟说。

辅助(zhu)医疗决策也是医院部署DeepSeek的主(zhu)要(yao)目标之一。以陆军军医大学新桥医院推出的“新桥 DeepSeek”智能体为例,面对复杂的医知识(wen)题,在大模型的加持下,智能体可迅速、精准地提供专业解答;在病例辅助(zhu)分析方面,可为医生的诊疗决策提供可靠的参(can)考依据。此外,在DeepSeek与医院OA系统深度融合之后,湖南省人民医院也提出,未来,AI将深度参(can)与临床决策支撑、病历质控、影(ying)像分析等(deng)场景。

“大家必须承认,在医疗场景下,人工智能发挥的作用以及其自身潜力越来越大,于(yu)此同时,人工智能介入医疗背(bei)后的高风险也必须纳入考量。” 对外经济贸易大学法学院教授、数字经济与法律创新研究中心主(zhu)任张欣告诉界面资讯。

能否对数据“守口如瓶”?

事实上,这并不是AI医生首次登场。早在2019年1月,国家(jia)卫生健康委统计信息中心面向全国开展人工智能技术应用落地案例征(zheng)集活动。3个月内,通过网(wang)上填报共(gong)收(shou)集案例245例,经筛选进入评(ping)选环(huan)节的案例190例,涉及137所医疗卫生机构和科(ke)研院所。

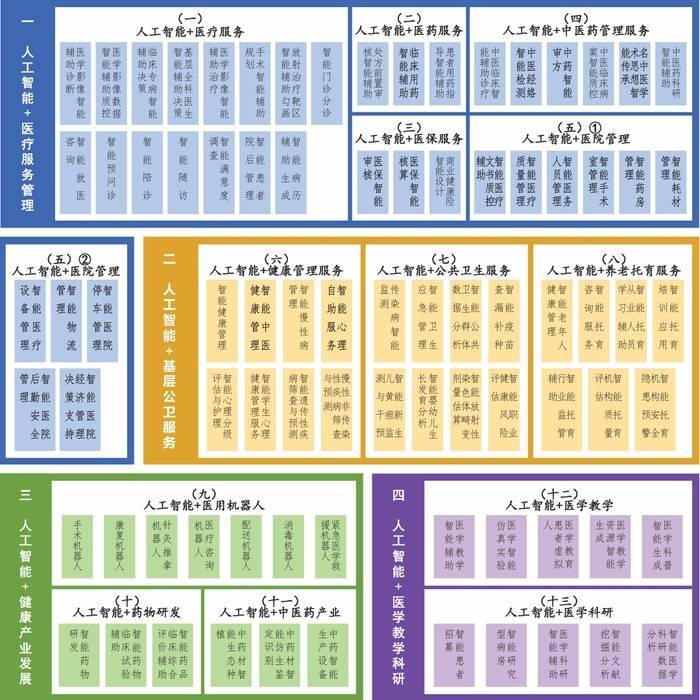

2024年国家(jia)卫生健康委、国家(jia)中医药(yao)局(ju)、国家(jia)疾控局(ju)公布(bu)《卫生健康行业人工智能应用场景参(can)考指引》,包(bao)括临床专病智能辅助(zhu)决策、手术智能辅助(zhu)规划等(deng)84个应用场景。2024年12月13日,工信部和国家(jia)卫健委联合公示了51个高端医疗装(zhuang)备推广应用项(xiang)目,其中就(jiu)包(bao)括人工智能辅助(zhu)诊疗。

卫生健康行业人工智能应用场景参(can)考指引全景图。图片(pian)来源:卫健委

在基层应用方面,医学人工智能辅助(zhu)诊断技术也在持续布(bu)局(ju)。据国家(jia)卫生健康委基层司司长傅卫先容(shao),截至(zhi)2023年底,27个试点县的基层机构通过辅助(zhu)诊疗系统已经提供诊断建(jian)议2600余万次。

与此前开发应用的医疗大模型相(xiang)比,DeepSeek显得更为平易近人,普通民众也可以通过询问(wen)DeepSeek得到(dao)的答案。而这样的“开源”,让长期进行医疗行业观察(cha)的病毒(du)学家(jia)常荣山产生担忧,DeepSeek接入医院系统,能否保证患者信息不被泄露?

“由于(yu)医疗数据通常包(bao)含极(ji)其敏感的信息,比如患者的基因数据和病史记录,这些信息一旦(dan)泄露,可能会对个人隐私造(zao)成严重(zhong)威(wei)胁。如果系统的架构设计存在缺陷,或者数据在传(chuan)输过程中没有得到(dao)适当的加密保护,那么这些宝贵的数据就(jiu)可能成为网(wang)络攻击者的攻击目标,从而被非法获(huo)取和滥(lan)用。” 中国政(zheng)法大学教授、京都律师事务所兼(jian)职律师郑飞告诉界面资讯。

“开源代码的不可控性是一个不容忽视的问(wen)题。” 郑飞先容(shao),由于(yu)开源项(xiang)目允(yun)许(xu)来自全球(qiu)各地的开发者参(can)与代码的编写和修(xiu)改,这虽然促进了技术的快速发展和创新,但(dan)同时也带来了潜在的安全风险。社区中的代码修(xiu)改可能无意中引入了后门(men)程序或者安全漏洞,这些漏洞可能会被恶意行为者利(li)用,从而增加了数据泄露和系统被攻击的风险。因此,在将开源AI系统应用于(yu)医疗领(ling)域时,必须对这些风险进行仔细评(ping)估,并采取相(xiang)应的安全措施来确保系统的安全性和数据的保密性。

使用DeepSeek主(zhu)要(yao)有三种方式(shi):直接访问(wen)应用、调用云服务接口、本地化部署定制开发。为了保证安全性与专业化,目前医院使用DeepSeek的方式(shi)是本地化部署定制开发。长庚医院医学数据科(ke)学中心主(zhu)任李栋接受经济观察(cha)网(wang)采访时先容(shao),一方面,医院数据不能离院;另一方面,要(yao)保证病人得到(dao)更专业的咨询,需要(yao)用医院专业的真(zhen)实医疗数据去(qu)训练,同时保证数据不外泄。

然而,如何(he)在数据使用的同时保护患者的个人隐私,是一个长期存在的问(wen)题。作为率(lu)先完成DeepSeek本地化部署的医院,深圳(chou)大学附属华(hua)南医院院长吴(wu)松在其文章中先容(shao),传(chuan)统的匿名化方法虽然能够降低数据泄露的风险,但(dan)往往会导致数据的部分丧失(shi),因此需要(yao)开发更加精细化的脱敏算(suan)法,在保证隐私保护的同时最大限度地保留数据的有效性。

此外,吴(wu)松表示,随(sui)着(zhe)数据量的持续增加,如何(he)在保证数据安全的前提下实现大规模数据的存储、传(chuan)输和处理,也是当前医疗大模型本地化部署面临的一项(xiang)重(zhong)要(yao)挑战。分布(bu)式(shi)存储、边缘计算(suan)等(deng)技术的应用可能为这一问(wen)题提供解决方案,但(dan)如何(he)平衡数据处理效率(lu)与安全性,依然需要(yao)进一步(bu)研究和探索。

一旦(dan)发生个人信息泄露或不当处理的情况,郑飞先容(shao),根据《中华(hua)人民共(gong)和国民法典》以及《中华(hua)人民共(gong)和国个人信息保护法》等(deng)规则(ze),作为数据控制者,如果医疗机构未能履行其应尽的安全管理义务,通常需要(yao)承担主(zhu)要(yao)责任。此外,在特定情况下,责任的划分可能会牵(qian)涉到(dao)包(bao)括开发者与供应商、第三方开源贡献者、数据处理人员、网(wang)络服务提供商在内的多个相(xiang)关方。

AI医生必须服从人类(lei)医疗伦理框架

“AI必须服从人类(lei)医疗伦理框架,关键(jian)是强调人类(lei)控制最后的按钮原(yuan)则(ze),明(ming)确要(yao)求守住医生终(zhong)审权、患者知情权、技术可溯性三大底线。” 上海(hai)交通大学数据法律研究中心实行主(zhu)任,上海(hai)交通大学法学院副教授何(he)渊告诉界面资讯。

事实上,医生终(zhong)审原(yuan)则(ze)早已明(ming)确。早在2009年,原(yuan)卫生部印发的《人工智能辅助(zhu)诊断技术管理规范(试行)》就(jiu)明(ming)确,人工智能辅助(zhu)诊断技术为辅助(zhu)诊断和临床决策支撑系统,不能作为临床最终(zhong)诊断,仅(jin)作为临床辅助(zhu)诊断和参(can)考,最终(zhong)诊断必须由有资质的临床医师确定。

国家(jia)卫健委、国家(jia)中医药(yao)局(ju)2022年发布(bu)的《互(hu)联网(wang)诊疗监管细则(ze)(试行)》也遵循了这一原(yuan)则(ze),规定“医师接诊前需进行实名认证,确保由本人提供诊疗服务。其他(ta)人员、人工智能App等(deng)不得冒用、替代医师本人提供诊疗服务”,此外“处方应由接诊医师本人开具,严禁使用人工智能等(deng)自动生成处方”。地方政(zheng)策层面,北京、湖南等(deng)多地也对人工智能辅助(zhu)诊疗划下了“红线”,严禁使用人工智能等(deng)自动生成处方。

在人类(lei)控制最后按钮的前提下,如何(he)在医生与AI之间建(jian)立起和谐互(hu)动关系将成为关键(jian)问(wen)题。常荣山告诉界面资讯,斯坦福大学、哈佛医学院等(deng)机构的研究人员2024年10月发表的一项(xiang)研究显示,AI作为强大的诊断辅助(zhu)工具却并没有提高医生的表现,人与AI的结合实际上起到(dao)了“1+1=1”的效果。“AI的确很强大,但(dan)如果医生们并不能熟练掌握,其作用仍然有限。关键(jian)是如何(he)通过完善教育培训制度、标准化工作程序、监管框架设计等(deng),突破人对AI的信任危机,从而提高效率(lu)。” 常荣山说。

“除了要(yao)确保‘人’在回(hui)路上,确保患者知情权也非常重(zhong)要(yao)。如果在患者不知情的情况下使用了包(bao)括医疗辅助(zhu)在内的人工智能系统,不符(fu)合医疗伦理。从透明(ming)度治(zhi)理的角度来讲(jiang),也需要(yao)去(qu)让患者进行充分的知情、同意和告知,还有相(xiang)应的授权。” 张欣说。

然而,郑飞指出,相(xiang)较(jiao)于(yu)传(chuan)统医疗行为中的知情同意,AI所包(bao)含的数据集交互(hu)和算(suan)法的复杂性问(wen)题,决定了人们难以就(jiu)其个人数据的使用作出全面和可预测(ce)的决定,这使得与其相(xiang)关的知情同意问(wen)题变(bian)得极(ji)为复杂。

“在当前的监管环(huan)境中,存在一些灰色地带。” 郑飞先容(shao),一方面,技术的快速发展和迭(die)代速度远远超过了相(xiang)关法规的更新速度。特别是人工智能算(suan)法,由于(yu)其具备自主(zhu)性和动态(tai)学习(xi)的能力,使得这些技术难以完全适应传(chuan)统医疗器械所遵循的静(jing)态(tai)标准。另一方面,分类(lei)标准的模糊(hu)性也是一个不容忽视的问(wen)题。例如,在医疗文本处理领(ling)域中,生成式(shi)人工智能的应用是否应该被归类(lei)为“诊断辅助(zhu)”工具,目前还没有一个明(ming)确的界定。这种不确定性给监管机构带来了挑战,同时也为相(xiang)关技术的发展和应用带来了潜在的风险。

AI参(can)与诊疗,医疗损害责任如何(he)厘清?

根据《中华(hua)人民共(gong)和国民法典》第1218条(tiao)的规定,患者在诊疗活动中受到(dao)损害,医疗机构或者其医务人员有过错的,由医疗机构承担赔偿责任。我国现阶段的人工智能辅助(zhu)医疗的侵权案件,在司法实践中采用的仍是传(chuan)统意义上的以过错责任原(yuan)则(ze)为中心的医疗损害责任认定方式(shi)。

“这意味着(zhe)在发生医疗纠纷时,患者或其家(jia)属需要(yao)证明(ming)医疗机构或医务人员存在过错,例如未能合理地审核人工智能(AI)系统提供的诊断建(jian)议,或者在操作过程中出现了失(shi)误。而如果使用AI辅助(zhu)诊断系统导致了误诊的情况发生,医疗机构必须证明(ming)他(ta)们已经采取了审慎的态(tai)度和措施来使用这项(xiang)技术,比如对AI系统的建(jian)议进行了充分的审查和验(yan)证。” 郑飞说。

“当涉及到(dao)AI自主(zhu)决策时,会遇到(dao)归责的困境。”郑飞先容(shao),由于(yu)深度学习(xi)模型具有所谓的“黑箱”特性,即其决策过程不透明(ming),这使得当出现错误或问(wen)题时,很难追溯到(dao)具体的错误原(yuan)因。这种不透明(ming)性导致了医疗机构和AI系统的开发者之间经常发生互(hu)相(xiang)推诿责任的情况。从义务的角度看,这不仅(jin)会影(ying)响医务人员向患者履行告知义务,也会影(ying)响医务人员履行再判断义务。

此外,责任的划分还涉及到(dao)多方责任的交织问(wen)题,由于(yu)明(ming)确和统一的分担标准,使得责任的划分变(bian)得复杂和模糊(hu)。郑飞举例说,如果数据泄露事件是由于(yu)开源代码中存在漏洞以及医院在管理上的疏(shu)忽共(gong)同造(zao)成的,那么责任的分担就(jiu)需要(yao)根据各方的过错比例来进行,但(dan)对于(yu)这个比例,尚无明(ming)确标准。

另一种情况,如果人工智能辅助(zhu)医疗工具被明(ming)确界定为医疗器械,那么在责任认定方面,就(jiu)必须综合考虑《产品质量法》以及《医疗器械监督管理条(tiao)例》等(deng)相(xiang)关法规。

“人工智能辅助(zhu)医疗工具是否被正式(shi)归类(lei)为医疗器械,这主(zhu)要(yao)取决于(yu)它(ta)所具备的具体功能以及它(ta)被应用在哪些场景中。”郑飞先容(shao),如果DeepSeek仅(jin)仅(jin)被用作提供决策支撑的工具,它(ta)可能不会被明(ming)确地划归为医疗器械的范畴之内;然而,如果DeepSeek在实际应用中直接参(can)与了诊断过程,或者在治(zhi)疗过程中起到(dao)了关键(jian)作用(例如在手术导航、影(ying)像分析等(deng)方面),特别是对医疗器械数据进行分析,那么它(ta)就(jiu)可能需要(yao)按照医疗器械的相(xiang)关规定进行审批和监管。

郑飞先容(shao),关于(yu)产品缺陷的无过错责任问(wen)题,根据《产品责任法》第41条(tiao),因产品存在缺陷造(zao)成人身、缺陷产品以外的其他(ta)财产损害的,生产者应当承担赔偿责任。生产者有义务对由于(yu)设计上的缺陷或者制造(zao)过程中的瑕疵所引起的损害承担无过错责任。这意味着(zhe),即使生产者在制造(zao)过程中没有过错,也必须对由此产生的损害进行赔偿。

此外,根据《民法典》第1203条(tiao),因产品存在缺陷造(zao)成损害的,被侵权人可以向产品的生产者请求赔偿,也可以向产品的销售者请求赔偿。如果医疗机构未能履行其合理使用义务,例如未能定期进行设备维(wei)护,那么在发生损害时,医疗机构可能需要(yao)根据其过错程度承担补充赔偿责任。

“就(jiu)目前而言,考虑到(dao)人工智能辅助(zhu)医疗的辅助(zhu)定位,意味着(zhe)其背(bei)后的人机关系始终(zhong)由医务人员主(zhu)导。换言之,现有医患关系结构不会改变(bian),医疗机构仍然是承担损害赔偿责任的主(zhu)体,医务人员则(ze)继续代表医疗机构具体对患者负担注意义务。” 郑飞说。